Anthropic推出Claude Code代码审查工具 助企业应对AI生成代码激增

背景与动机

随着Claude Code等大型语言模型在企业内部被广泛用于“一键生成代码”,Pull Request 的数量出现指数级增长。Anthropic 发现企业开发团队面临两大痛点:代码审查瓶颈导致交付延迟,以及AI生成代码潜在的逻辑错误和安全风险。为此,Anthropic 在Claude平台推出了专门的 Code Review 功能,旨在以自动化方式提前捕捉高危问题。

产品核心功能

- 多代理并行审查:系统调度多个专用Agent分别从逻辑、依赖、性能和安全四个维度检查代码,每个Agent负责一类问题的检测。

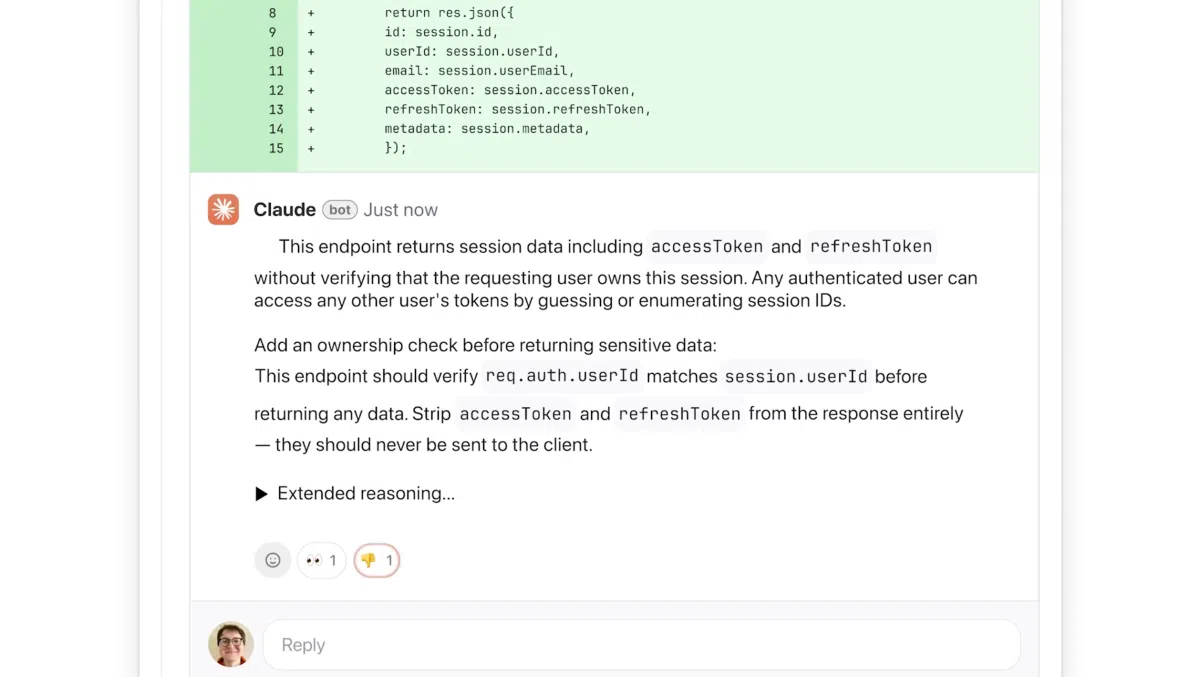

- 一步到位的 GitHub 集成:开启后,Code Review 会在每个 Pull Request 上自动留下评论,标注错误位置并提供可执行的修复建议。

- 错误严重度颜色标记:红色(最高风险)、黄色(需关注)和紫色(历史遗留或低优先级)三色标签帮助工程师快速定位关键问题。

- 轻量安全分析:在逻辑审查之外,系统提供基础的安全扫描,并支持企业自定义安全规则。

定价与使用成本

Anthropic 采用基于 Token 的计费模式,每次审查的费用约为 15–25 美元,具体取决于代码行数和复杂度。该费用相当于一次高质量人工代码审查的成本,且能够显著降低因Bug导致的后期维护开销。

目标客户与市场意义

Code Review 目前在 Claude for Teams 与 Claude for Enterprise 的研究预览阶段提供,首批客户包括 Uber、Salesforce、Accenture 等大规模使用 Claude Code 的企业。Anthropic 透露,Claude Code 的年度收入已突破 25亿美元,而 Code Review 的推出预计将进一步提升企业对Claude生态的黏性。

业界反响

行业分析师认为,随着“vibe coding”模式的普及,AI生成代码的质量控制成为企业的关键需求。Anthropic 的多代理审查方案在保持高并发的同时提供了可解释的错误定位,弥补了此前多数AI审查工具只关注代码风格、缺乏深层逻辑判断的短板。

展望

Anthropic 表示,未来将继续扩展 Code Review 的安全检测深度,并探索与 Claude Code Security 的深度融合,打造从代码生成到安全交付的全链路 AI 助手。随着企业对AI辅助开发的依赖加深,自动化审查有望成为软件工程的标准配置,推动行业整体代码质量向更高水平迈进。